[Презентация] Искусственный интеллект

Не подходит Презетация?

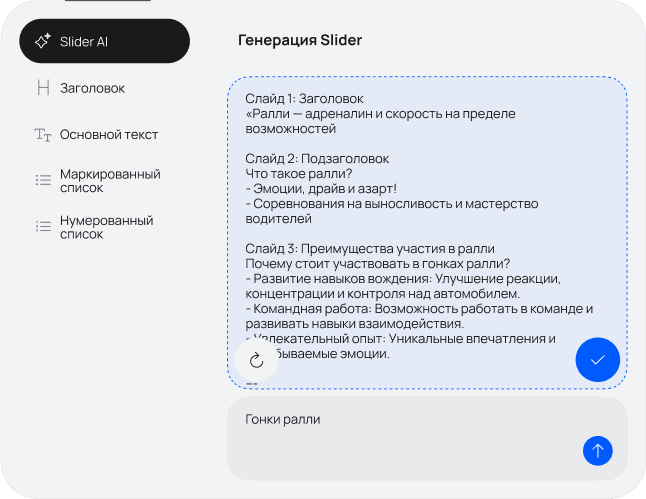

Создайте свою быстро и легко. Используйте нейросети, готовые шаблоны и голосового ИИ-помощника

Транскрипция презентации

Слайд 1: Искусственный интеллект

Слайд 2: Что такое искусственный интеллект?

Слайд 3: История развития искусственного интеллекта.

Слайд 4: Применение искусственного интеллекта в современном мире.

Слайд 5: Преимущества и недостатки искусственного интеллекта.

Заберите Презентацию бесплатно FREE

Зарегистрируйтесь и отредактируйте её под свои задачи за пару минут.

Шаблоны презентаций, доступные бесплатно в редакторе Slider Ai

Бесплатные шаблоны в редакторе Slider

Презентация диз...

Текст

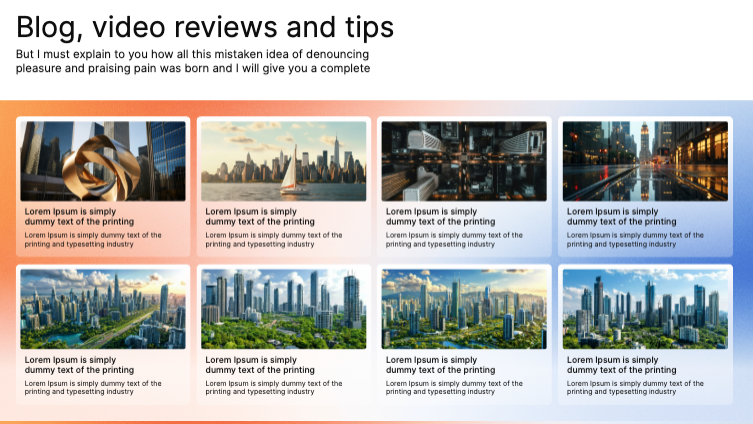

Медиа

Фигуры

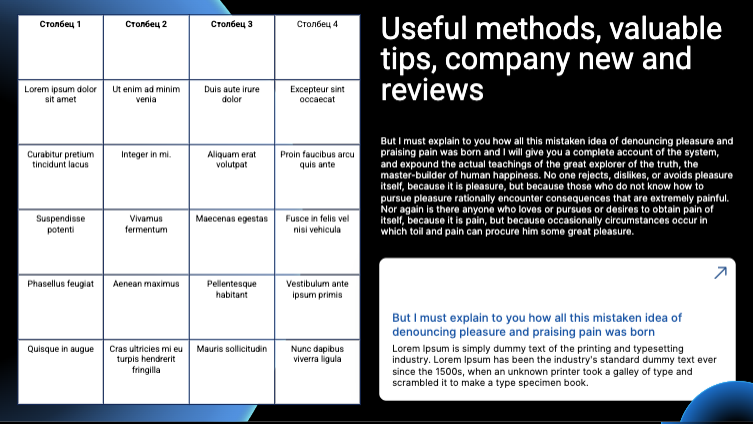

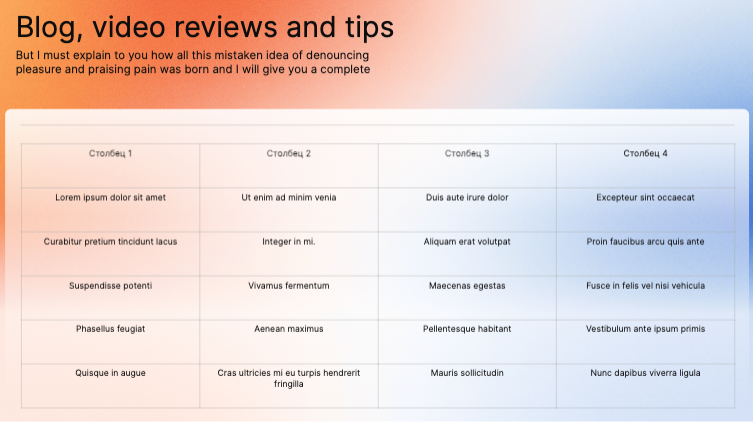

Таблица

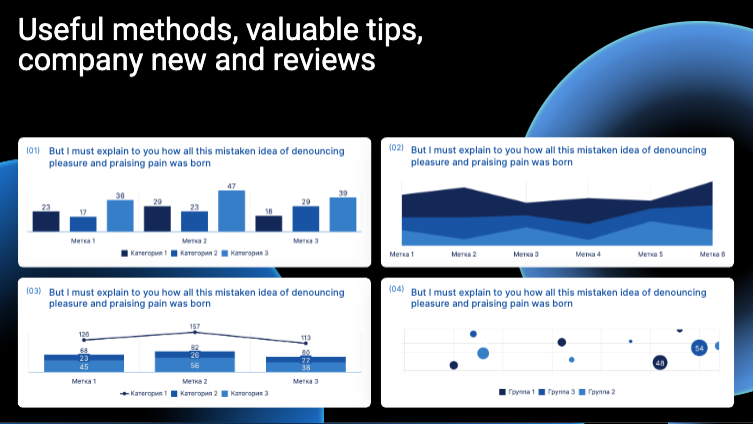

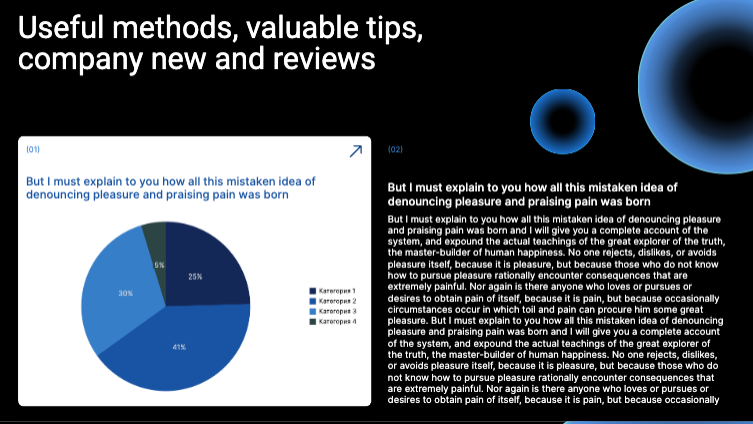

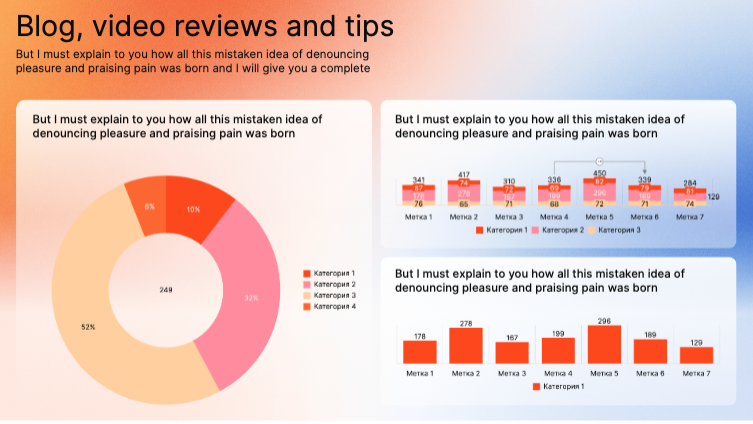

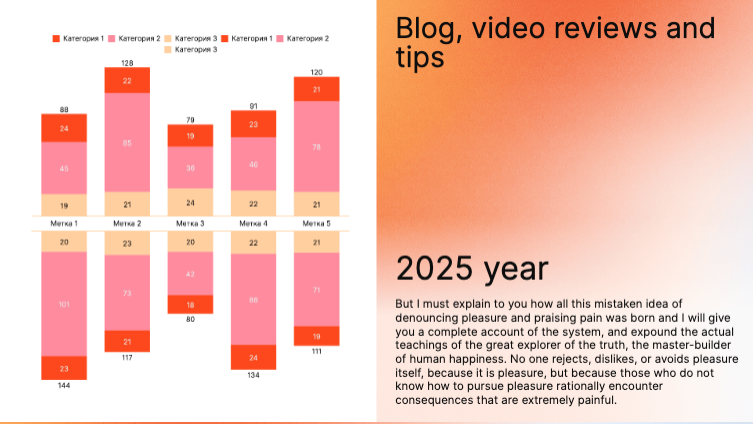

Диаграммы

3D модели

500

Создать

Добро

пожаловать

в Slider Ai

пожаловать

в Slider Ai

Нам доверяют

Кирилл В

трафик-менеджер

В редакторе я в основном оформляю свои кейсы для демонстрации клиентам. Как правило, использую готовый шаблон, прикрепляю документы и генерю презентацию как черновик, а потом уже добавляю данные по кейсам в виде диаграмм для наглядности, дорабатываю текст, визуал, но даже так времени это занимает на...

Сергей Н

Руководитель компании

Я в дизайне вообще ничего не понимаю, поэтому мне очень помогает функция, когда я могу просто накидать сырой текст на слайды, а затем все это причесать с помощью ии. Минут за 15 можно сделать аккуратную и стильную презентацию. Это реально сильно экономит силы и время.

Анна К

бренд-менеджер

Slider Ai для нас спасение при подготовке презентаций стратегии и отчетов для клиентов. В отличии от других редакторов, которыми мы с командой пользовались раньше, здесь не нужно быть дизайнером, чтобы создавать красивые презентации, за которые не стыдно перед важными клиентами.

Ирина М

отдел маркетинга

Как руководитель отдела, ценю, что с помощью Slider Ai все презентации команды выходят в едином корпоративном стиле. Это укрепляет бренд и выглядит профессионально. Встроенные диаграммы, особенно каскадные и Ганта, незаменимы для визуализации данных. Настройка бренд-кита заняла у нас 15 минут, и теп...

Ольга М

бизнес-тренер

В редакторе Slider Ai мне проще делать презентации для своих выступлений, потому что нужно по минимуму что-то делать вручную, много функций, которые позволяют просто нажать на кнопку и получить готовый результат. Плюсом есть возможность добавить видео прямо на слайды, а еще использовать 3D модели, р...

Ваша следующая великая работа всего в одном шаге от вас